Desvendando os LLMs: Entenda Por Que São o 'Autocomplete Mais Poderoso do Mundo'

Desvendando os LLMs: Entenda Por Que São o 'Autocomplete Mais Poderoso do Mundo'

Modelos de Linguagem Grandes (LLMs), como o ChatGPT, Claude e Gemini, são a base da IA generativa. Este artigo explica como eles funcionam, desde a previsão da próxima palavra até o treinamento complexo que os torna capazes de seguir instruções e gerar respostas alinhadas às preferências humanas, revelando que, em sua essência, são um poderoso sistema de autocompletar.

O Que São LLMs? Mais Que um Simples Autocomplete

Modelos de Linguagem Grandes, ou LLMs (Large Language Models), são a tecnologia por trás de serviços de inteligência artificial generativa que se tornaram populares, como ChatGPT, Claude e Gemini. Embora suas capacidades pareçam quase mágicas, o conceito fundamental por trás de um LLM é surpreendentemente simples: ele é o sistema de autocompletar mais poderoso do mundo.

Em sua essência, um LLM recebe um texto como entrada e gera a continuação mais provável desse texto. Ele não 'entende' o mundo como nós, mas é extremamente eficiente em prever qual será o próximo elemento em uma sequência de texto.

A Linguagem dos LLMs: Tokens

Para um LLM, o texto não é composto por palavras ou caracteres, mas por 'tokens'. Um token pode ser uma palavra inteira, parte de uma palavra, um sinal de pontuação ou até mesmo um espaço. Por exemplo, a palavra 'Pré-histórico' pode ser dividida nos tokens 'Pré' e 'histórico'. Cada token tem um número único (seu ID), e é com esses IDs que o LLM realmente trabalha.

O 'tokenizer' é a ferramenta que converte o texto que digitamos em tokens (codificação) e os tokens de volta em texto (decodificação). Cada LLM é treinado com um tokenizer específico e um vocabulário limitado de tokens, o que significa que ele só pode processar e gerar o que está dentro desse vocabulário.

Como um LLM Gera Texto: Previsão do Próximo Token

O processo de geração de texto por um LLM é conceitualmente direto. Primeiro, o texto de entrada é convertido em uma sequência de IDs de tokens. Esses IDs são então passados para o LLM, que os processa e calcula a probabilidade de cada token em seu vocabulário ser o próximo na sequência. O LLM não escolhe um token diretamente, mas sim fornece uma distribuição de probabilidades para todos os tokens possíveis.

A partir dessa distribuição, um processo chamado 'amostragem' seleciona o próximo token. A forma como esse token é escolhido (por exemplo, sempre o de maior probabilidade ou com alguma aleatoriedade controlada) pode influenciar muito a qualidade e a criatividade da resposta. É crucial entender que, independentemente de suas capacidades impressionantes, a única coisa que um LLM faz é prever o próximo token.

O Treinamento de um LLM: Da Aleatoriedade à Inteligência

Quando um LLM é criado pela primeira vez, ele é como um 'macaco com uma máquina de escrever', gerando tokens aleatórios. Para transformá-lo nas ferramentas poderosas que conhecemos, ele passa por um processo de treinamento em várias etapas:

1. Pré-treinamento: Adquirindo Conhecimento Geral

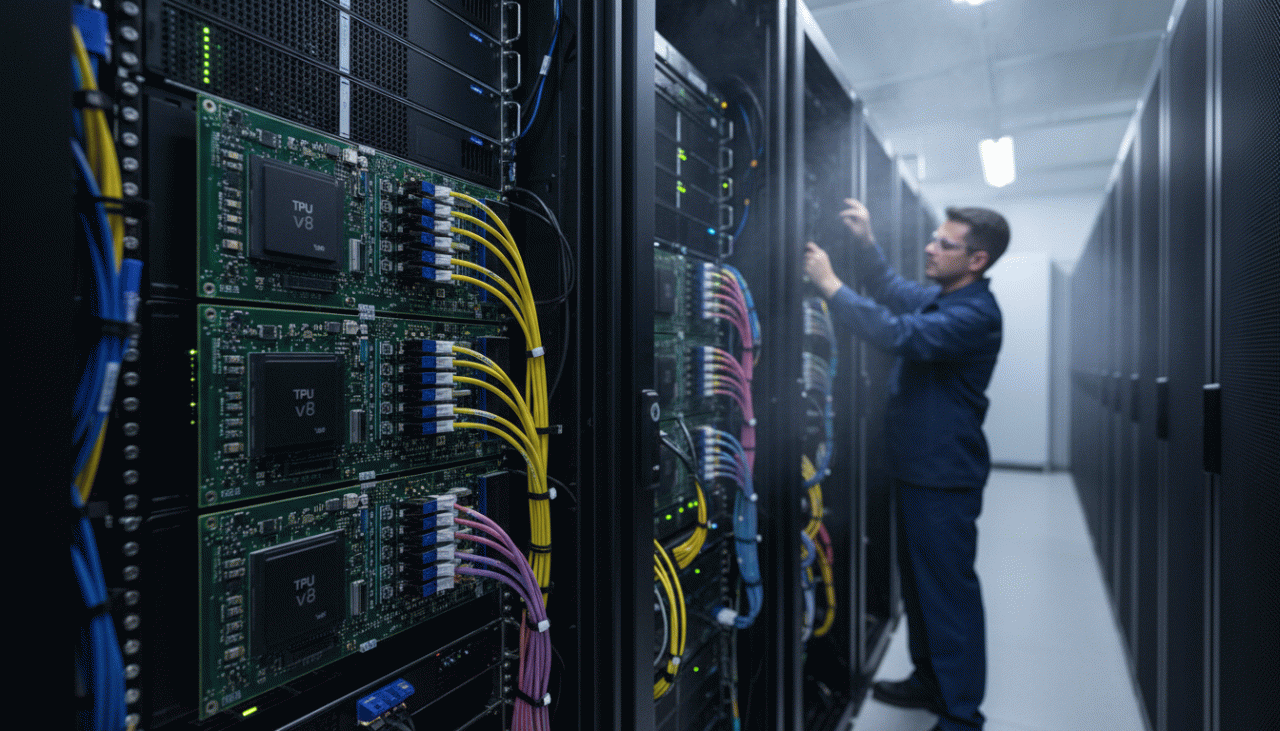

O objetivo do pré-treinamento é dotar o LLM de 'conhecimento geral' sobre a linguagem: como ela se estrutura, como é o código, fatos, etc. Isso é feito treinando o modelo para completar texto em vastas quantidades de dados. Empresas como OpenAI, Google e Meta utilizam conjuntos de dados proprietários que incluem trilhões de tokens de texto da internet, livros, artigos científicos e código. O processo envolve alimentar o LLM com uma parte de um texto e treiná-lo para prever o próximo token. Isso exige um poder computacional enorme, com milhares de servidores GPU trabalhando por meses.

2. Ajuste Fino por Instrução: Aprendendo a Seguir Comandos

Após o pré-treinamento, um LLM é capaz apenas de completar texto. Se pedirmos para 'Escrever um poema', ele pode continuar com 'sobre seu primeiro amor', em vez de realmente escrever um poema. Para que o LLM aprenda a seguir instruções, ele passa por um 'ajuste fino por instrução'. Isso envolve criar um conjunto de dados com pares de 'instrução-resposta' (por exemplo, 'Escreva um poema' seguido de um poema real). O LLM é então treinado para completar esses novos tipos de sequências, aprendendo a associar uma instrução a uma resposta adequada.

3. Alinhamento com Preferências Humanas: Refinando as Respostas

Mesmo após o ajuste fino, um LLM pode gerar várias respostas válidas para uma instrução, mas algumas podem ser muito técnicas, outras muito informais, e nem todas seriam as preferidas por um humano. Para resolver isso, o modelo é alinhado com as preferências humanas. Um conjunto de dados é criado onde humanos escolhem qual resposta preferem entre duas opções para uma dada instrução. O LLM é então treinado para aumentar a probabilidade das respostas preferidas pelos humanos e diminuir a das respostas menos preferidas. Este passo é crucial para que os LLMs gerem respostas que sejam úteis, relevantes e agradáveis para os usuários.

Conclusão: A Essência da Inteligência Artificial Generativa

Depois de passar por pré-treinamento, ajuste fino por instrução e alinhamento com preferências humanas, um LLM se torna capaz de realizar tarefas complexas como escrever poemas, resolver problemas matemáticos e gerar código. No entanto, é fundamental lembrar que, em sua essência, o LLM ainda está fazendo exatamente o que foi treinado para fazer: prever o próximo token. Essa capacidade de previsão, combinada com um treinamento sofisticado, é o que o transforma no 'autocomplete mais poderoso do mundo', impulsionando a revolução da inteligência artificial generativa.

Fonte: Do you even know how LLMs work? | Alfredo