Inteligência de Vídeo Eficiente: Como a IA Está Transformando a Análise de Vídeos Até 2026

Inteligência de Vídeo Eficiente: Como a IA Está Transformando a Análise de Vídeos Até 2026

A inteligência artificial está revolucionando a forma como entendemos e processamos vídeos, superando desafios como o grande volume de dados e a complexidade multimodal. Até 2026, avanços em codificadores universais, atenção eficiente e segmentação em dispositivos móveis permitem que sistemas de IA analisem horas de filmagem com alta precisão e eficiência, tornando a análise de vídeo mais acessível e prática para diversas aplicações.

A Revolução da Inteligência de Vídeo Eficiente

Há cinco anos, a compreensão de vídeo por inteligência artificial se limitava a tarefas mais simples, como reconhecimento de ações em clipes curtos. Hoje, em 2026, a Inteligência de Vídeo Eficiente permite que modelos de linguagem visual (VLMs) analisem filmagens de horas de duração, rastreiem objetos em tempo real em dispositivos móveis e até mesmo que um único codificador de 100 milhões de parâmetros iguale a performance de especialistas em diversas tarefas de compreensão de imagem e vídeo. Essa transformação é resultado de uma reavaliação do que um modelo de vídeo precisa fazer e da consideração séria das restrições de implantação.

Por Que o Vídeo é Mais Complexo para a IA?

O processamento de vídeo apresenta desafios únicos que o tornam mais difícil do que o texto ou imagens estáticas:

- Volume de Tokens: Um minuto de vídeo a 30 quadros por segundo pode gerar milhões de “tokens visuais” antes mesmo de considerar áudio ou texto. Nenhum modelo de linguagem grande (LLM) consegue absorver essa quantidade de dados sem compressão.

- Escassez de Informação: Quadros adjacentes são frequentemente muito semelhantes, e os eventos de interesse são raros e distribuídos de forma desigual. Amostrar cada quadro é ineficiente, mas a amostragem uniforme pode perder informações cruciais, exigindo seleção adaptativa.

- Multimodalidade Intrínseca: O vídeo raramente é apenas visual. Áudio é essencial em muitos contextos, como vídeos egocêntricos ou conversacionais, adicionando complexidade e requisitos de sincronização.

Codificadores de Visão: Do Especialista ao Universal

A primeira etapa em um sistema de vídeo é codificar cada quadro. Anteriormente, isso significava escolher um codificador específico para cada tarefa, aceitando suas limitações. Modelos como CLIP (para recuperação semântica) e DINOv2 (para predição densa) eram especialistas. No entanto, um sistema de vídeo em um dispositivo como um wearable ou câmera inteligente não pode carregar um “backbone” separado para cada capacidade.

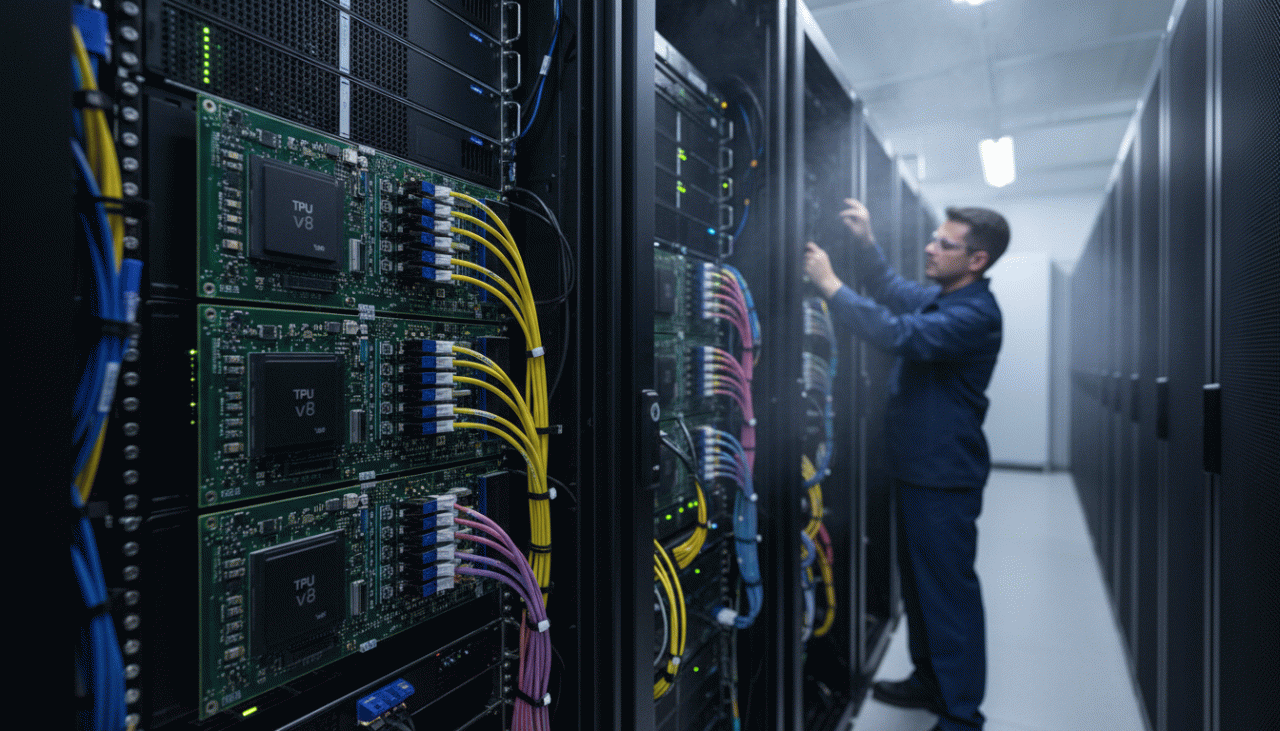

A solução veio com os codificadores aglomerativos, como o Efficient Universal Perception Encoder (EUPE). Este avanço permite que um único codificador compacto, com menos de 100 milhões de parâmetros, herde as capacidades de múltiplos modelos especialistas (segmentação, profundidade, alinhamento visão-linguagem) através de um processo de destilação. Para sistemas de vídeo, isso significa menos codificadores para carregar e um ganho significativo de latência, crucial para a Inteligência de Vídeo Eficiente.

Atenção Eficiente para Sequências Longas

Com os quadros codificados, a atenção se torna o gargalo. A atenção padrão é computacionalmente cara para sequências longas de vídeo. Três abordagens principais surgiram:

- Atenção de Janela Deslizante e Esparsa: Restringe a atenção a um subconjunto local ou aprendido de tokens, como visto em LongLLaMA e Mistral.

- Atenção Linear: Reduz a complexidade computacional para linear, como em Performer e Linformer, sendo útil quando o comprimento da sequência domina o cálculo.

- Arquiteturas Híbridas: Combinam autoatenção para relações de curto alcance e blocos SSM para dependências de longo alcance, como em Jamba. Para vídeo, isso se traduz em atenção espacial dentro de um quadro e atenção temporal eficiente entre muitos quadros.

Segmentação e Rastreamento em Dispositivos

A segmentação e o rastreamento são primitivas essenciais para extrair informações de cada quadro. O SAM (Segment Anything Model) definiu o modelo de fundação para segmentação orientada por prompts. O SAM 2 estendeu isso para vídeo com um módulo de memória que mantém filas de quadros recentes e objetos rastreados.

Nossa pesquisa focou na compressão desses modelos para implantação em dispositivos. O EfficientSAM tornou a segmentação em dispositivos prático pela primeira vez, e o EdgeTAM levou o rastreamento de vídeo de nível de modelo de fundação para dispositivos móveis de consumo, como o iPhone 15 Pro Max, rodando a 16 quadros por segundo. Isso demonstra que a propagação eficiente da memória, e não apenas o tamanho bruto do modelo, impulsiona os ganhos de produção para a Inteligência de Vídeo Eficiente.

3D e Profundidade a Partir de Vídeo

Além da estrutura 2D, o vídeo oferece fortes pistas para a compreensão 3D. O DepthLM, um modelo de linguagem visual com um backbone de 3 bilhões de parâmetros, demonstrou que pode igualar ou superar especialistas dedicados em benchmarks de profundidade métrica sem mudanças arquitetônicas, usando apenas ajuste fino supervisionado baseado em texto.

Isso significa que um único VLM pode lidar tanto com a profundidade quanto com o raciocínio de alto nível, simplificando substancialmente a implantação em dispositivos como headsets de realidade aumentada ou robôs.

Compreensão de Vídeos de Longa Duração

O desafio mais difícil é entender o significado de um vídeo inteiro, à medida que sua duração cresce de segundos para horas. O LongVU aborda isso com compressão adaptativa espaço-temporal, removendo redundâncias e selecionando quadros e tokens relevantes com base em consultas de linguagem. Isso permite que modelos como o LongVU e o Tempo processem vídeos de mais de uma hora com um orçamento de tokens muito menor, superando modelos de base que usam amostragem uniforme.

A compreensão de vídeo de longa duração é dominada pelo orçamento de tokens, e o campo está convergindo em uma combinação de alocação adaptativa de tokens, mecanismos de memória e poda guiada por linguagem para alcançar a Inteligência de Vídeo Eficiente em escala.

Fonte: v-chandra.github.io